Microsoftが、.NET Frameworkのオープンソース実装であるMonoの管理を、Unix系OS上でWindowsアプリを実行するためのソフトウェア「Wine」のWineHQチームに移管したことを発表しました。 Thank you to all the Mono developers! · Issue #21796 · mono/mono · GitHub https://github.com/mono/mono/issues/21796 Microsoft Hands Mono Over to the Wine Project - OMG! Ubuntu https://www.omgubuntu.co.uk/2024/08/microsoft-mono-project-to-wine Microsoftのジェフ・シュワルツ氏は、Monoプロジェクトの公式サイトとGitHub

「MIPSらしさを貫く」 データ移動技術でAI分野に攻勢:MIPS CEO Sameer Wasson氏(1/3 ページ) 2018年以降、MIPSコアからRISC-Vへと軸足を移したMIPS。MIPSはRISC-Vコアだけでなく、より高速な演算や低い消費電力へとつながる「データ移動」の技術で、AI(人工知能)分野に攻勢をかけようとしている。 MIPSの鍵は「データ移動」 MIPSは現在、アプリケーションに特化した同社のデータ移動(data movement)コアのターゲットをAI(人工知能)アプリケーションに据え、自社の強みを慎重に見極めながら進化している。MIPSのCEO(最高経営責任者)を務めるSameer Wasson氏は米国EE Timesに対し、「RISC-Vの競合他社も、公式、非公式の違いはあれど、ほとんどがAIに大きく軸足を移しているため、MIPSは選択を迫られた。当社が行

Meta plans to ship an extremely light mixed reality headset in 2027, The Information reports. The Information's new report comes less than a week after it reported that Mark Zuckerberg and his CTO Andrew Bosworth canceled a high-end headset planned for 2027 codenamed La Jolla, which previous reports had described as being a Quest Pro 2. Quest Pro 2 Reportedly Canceled By MetaMeta has reportedly ca

In this post we review the design and history of MX format reduced precision block floating point vector data formats. In the next post, we explore several possible RISC-V composable custom extensions to compute over them. Microsoft team demonstrates a more frugal way to do AI tensor math, rivals unite in support Last month at Open Compute Project Global Summit, seven rival processor and hyperscal

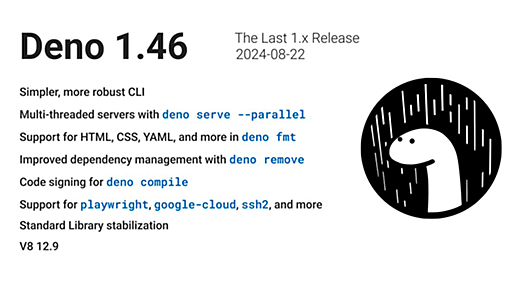

Node.jsの登場は、それまで比較的面倒だったノンブロッキングな非同期のネットワークプログラミングを容易にするAPIと、それをJavaScriptという非常に広く使われているプログラミング言語で利用可能にしたことで、サーバサイドにおけるJavaScriptランタイムという分野を新たに切り開くだけでなく、当時課題となっていたC10K問題の解決など、サーバアプリケーションの開発に大きな影響を与えました。 参考:Node.jsのコンセプトとは? ライアン・ダール氏による東京Node学園祭 基調講演(前編) その上で、Node.jsはAWS Lambdaに代表されるサーバレスコンピューティング環境の基盤として採用され、新たな分散コンピューティング環境の革新にも寄与してきたと言えます。 ライアン・ダール氏の反省:NodeからDenoへ、 しかしNode.jsの開発者であるライアン・ダール氏は201

米Cerebras Systemsは8月27日(現地時間)、AI開発者が同社のシステムにアクセスしてアプリを実行できるようにするAI推論ソリューション「Cerebras Inference」を発表した。「米NVIDIAのGPUベースのハイパースケールクラウドより20倍高速」で、はるかに安価だとしている。 Llama3.1 8Bで1秒当り1800トークン、Llama3.1 70Bで1秒当り450トークンを提供し、価格はLama 3.1 8Bで100万トークン当り10セント、Llama 3 70Bで100万トークン当り60セント。 Cerebrasは発表文で、NVIDIAなどのGPUシステムが推論に向かない理由を説明し、自社のシステムは「世界最大のチップを構築し、モデル全体をオンチップに保存することで、メモリ帯域幅のボトルネックを解決する」ことで、GPUのような遅延を解消したと主張する。

Run your AI inference applications on Cloud Run with NVIDIA GPUs Developers love Cloud Run for its simplicity, fast autoscaling, scale-to-zero capabilities, and pay-per-use pricing. Those same benefits come into play for real-time inference apps serving open gen AI models. That's why today, we’re adding support for NVIDIA L4 GPUs to Cloud Run, in preview. This opens the door to many new use cases

10年以上にわたりAWSのElastic Block Store(EBS)の開発に関わってきたマーク・オルソン氏が、EBSが共有ドライブに依存する単純なブロックストレージサービスから、毎日140兆回以上の操作を実行する大規模なネットワークストレージシステムへ発展するまでを振り返るブログ記事を投稿しました。 Continuous reinvention: A brief history of block storage at AWS | All Things Distributed https://www.allthingsdistributed.com/2024/08/continuous-reinvention-a-brief-history-of-block-storage-at-aws.html EC2がベータ版で使用可能になってから2年後の2008年にEBSはサービスを開始しました

リリース、障害情報などのサービスのお知らせ

最新の人気エントリーの配信

処理を実行中です

j次のブックマーク

k前のブックマーク

lあとで読む

eコメント一覧を開く

oページを開く